OpenAIがChatGPTの公平性で30%の改善を確認

要点まとめ;

- OpenAIは、100のトピックにわたる500のプロンプトを使用した内部評価を引用し、ChatGPTの政治的バイアスが30%削減されたと主張しています。

- 批評家らは、OpenAIが完全な方法論やデータセットを公開していないため、調査結果には独立した検証が欠けていると主張しています。

- EU AI法は、高リスクAIシステムに対してバイアス検出と第三者監査を義務付け、OpenAIへのコンプライアンス圧力を高めています。

- 進歩にもかかわらず、「公平性」の解釈が視聴者によって異なるため、大規模モデルにおける政治的中立性は未解決のままです。

OpenAIは、最新のChatGPTバージョン(GPT-5 instantとGPT-5 thinking)が、政治的に敏感なイデオロギー的トピックを扱う際の公平性において30%の改善を示すという新しい内部研究を発表しました。

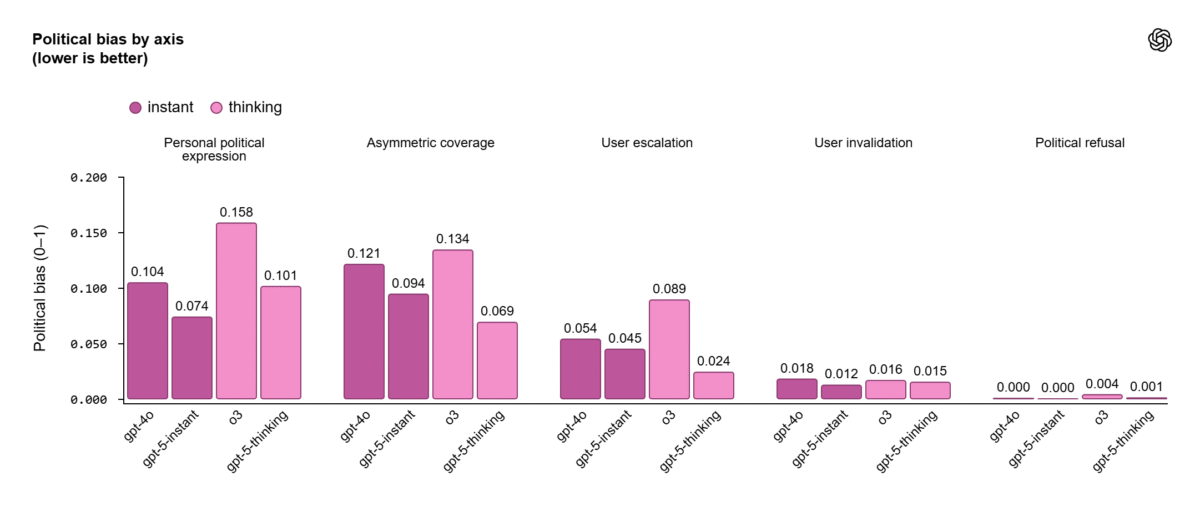

同社によると、この評価は100の異なる政治的テーマをカバーする500のプロンプトを使用し、5つのバイアスタイプを検出するために設計された構造化フレームワークを使用しました。これには、個人的意見、一方的なフレーミング、感情的な反応などが含まれていました。OpenAIの調査結果によると、数百万のユーザーインタラクションからのトラフィックに基づいて、ChatGPTの実世界の出力の0.01%未満が測定可能な政治的バイアスを表示しているとのことです。

同社は、これらの結果が、特に政治、メディア、社会的アイデンティティに関する会話において、AIシステムをより中立的で信頼性の高いものにするという進行中のミッションを反映していると述べています。

フレームワークはまだ独立した検証を欠いている

発表が進歩を示す一方で、専門家はOpenAIの公平性主張の再現性の欠如について懸念を表明しています。

同社は、内部テストで使用された完全なデータセット、評価基準、または特定のプロンプトを共有していないため、独立した研究者は、30%の低下が真の中立性を反映しているのか、単に管理された条件下でバイアスを隠す最適化されたプロンプトエンジニアリングなのかを検証することができません。

GPT‑5 instantとthinkingは、測定されたすべての軸でGPT-4oとo3を上回っています。

GPT‑5 instantとthinkingは、測定されたすべての軸でGPT-4oとo3を上回っています。

スタンフォード大学の今年初めの研究では、8社から24の言語モデルをテストし、10,000以上の公開評価を使用してスコアリングしました。調査結果によると、OpenAIの以前のモデルは、Googleなどの競合他社と比較して、より強い政治的傾向を示していたとされ、米国の政治的スペクトル全体のユーザーがイデオロギー的傾向に基づいて同じ回答を異なる解釈をしていました。

この議論は、文脈、文化、または表現方法によって中立的な表現でさえも党派的と解釈される可能性がある生成モデルにおける政治的バイアスの測定の複雑さを浮き彫りにしています。

EUルールが外部バイアス監査を推進

これらの調査結果は、欧州のAI法が新しい説明責任基準を設定し始めている中で発表されました。第10条の下で、高リスクおよび汎用AI(GPAI)モデルは、バイアスを検出、削減、文書化することが要求されています。

大規模な計算能力の代理である10²⁵浮動小数点演算(FLOPs)を超えるシステムは、システムリスク評価の実施、安全インシデントの報告、データガバナンス手順の文書化も行う必要があります。コンプライアンス違反は、最大3500万ユーロまたは世界的な売上高の7%の罰金につながる可能性があります。

独立監査人は間もなく、AIモデルの公平性を検証する上で重要な役割を果たし、人間とAIベースの評価の両方を使用して継続的なモニタリングを提供します。欧州委員会は2025年4月までに実践規範を発行する予定で、OpenAIのようなGPAIプロバイダーがコンプライアンスをどのように実証できるかについての詳細なガイダンスを提供します。

進歩と説明責任のバランス

内部的な楽観論にもかかわらず、OpenAIは規制当局や学者からの監視が高まっています。同社は、政治的およびイデオロギー的バイアスがデータ収集、ラベリング、強化学習技術全体にわたる長期的な改良を必要とするオープンな研究問題であることを認めています。

並行して、OpenAIは最近EUの独占禁止法規制当局と会談し、特にGoogleなどの主要テクノロジー企業のAI分野における支配に関する競争上の懸念を提起しました。週間8億人以上のChatGPTユーザーと5000億ドルを超える評価額を持つOpenAIは現在、イノベーションと規制の緊張の交差点に位置しています。

この記事「OpenAI Sees 30% Improvement in ChatGPT Fairness」は最初にCoinCentralに掲載されました。

関連コンテンツ

TFSF Venturesがプライベート・エクイティ・ポートフォリオ企業全体でのAIエージェント展開のためのフレームワークを発表

リアルBTCを受動的に獲得:Bitcoin Everlightの革新的なシャードモデルがローンチ