パラメータのわずか0.2%で完全微調整を上回る

リンク一覧

概要と1. はじめに

-

背景

2.1 Mixture-of-Experts

2.2 アダプター

-

Mixture-of-Adaptations

3.1 ルーティングポリシー

3.2 一貫性正則化

3.3 適応モジュールのマージと3.4 適応モジュールの共有

3.5 ベイジアンニューラルネットワークとモデルアンサンブルとの関連

-

実験

4.1 実験設定

4.2 主要な結果

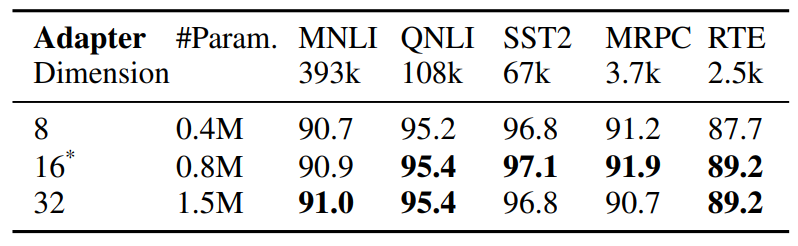

4.3 アブレーション研究

-

関連研究

-

結論

-

限界

-

謝辞と参考文献

付録

A. Few-shot NLUデータセット B. アブレーション研究 C. NLUタスクの詳細結果 D. ハイパーパラメータ

5 関連研究

PLMのパラメータ効率の良い微調整。 パラメータ効率の良い微調整(PEFT)に関する最近の研究は、大きく2つに分類できます

\

\ カテゴリー:(1) ヘッド微調整(Lee et al., 2019)、バイアス項調整(Zaken et al., 2021)などの既存パラメータのサブセットの調整、(2) アダプター(Houlsby et al., 2019; Pfeiffer et al., 2020)、プロンプト調整(Lester et al., 2021)、プレフィックス調整(Li and Liang, 2021)、低ランク適応(Hu et al., 2021)などの新しく導入されたパラメータの調整。単一の適応モジュールで動作する以前の研究とは対照的に、AdaMixはトレーニング中の確率的ルーティングと推論中の適応モジュールのマージを伴う適応モジュールの混合を導入し、単一モジュールと同じ計算コストを維持します。さらに、AdaMixは任意のPEFT手法の上に使用して、そのパフォーマンスをさらに向上させることができます。

\ Mixture-of-Expert (MoE)。 Shazeer et al., 2017は、Top-kルーティングと専門家間の負荷分散を持つ単一のゲーティングネットワークを備えたMoEモデルを導入しました。Fedus et al., 2021はTop-1ルーティングの初期化とトレーニングスキームを提案しています。Zuo et al., 2021はランダムルーティングの一貫性正則化を提案し、Yang et al., 2021は専門家プロトタイプを持つkTop-1ルーティングを提案し、Roller et al., 2021; Lewis et al., 2021は他の負荷分散問題に対処しています。上記のすべての研究は、モデル全体をゼロから事前トレーニングするスパースMoEを研究しています。対照的に、私たちは非常に少数のスパースアダプターパラメータのみを調整することにより、事前トレーニング済み言語モデルのパラメータ効率の良い適応を研究しています。

\ モデルの重みの平均化。 最近の探索(Szegedy et al., 2016; Matena and Raffel, 2021; Wortsman et al., 2022; Izmailov et al., 2018)では、すべてのモデルの重みを平均化することによるモデル集約を研究しています。(Matena and Raffel, 2021)は、様々なテキスト分類タスクで微調整された事前トレーニング済み言語モデルをマージすることを提案しています。(Wortsman et al., 2022)は、異なるハイパーパラメータ構成を持つ同じタスクでの様々な独立した実行からのモデルの重みの平均化を探索しています。モデル全体の微調整に関する上記の研究とは対照的に、私たちはパラメータ効率の良い微調整に焦点を当てています。大きなモデルパラメータを固定したまま、モデル調整中に更新される小さな調整可能なパラメータで構成される適応モジュールの重みをマージするための重み平均化を探索します。

6 結論

私たちは、大規模な事前トレーニング済み言語モデル(PLM)のパラメータ効率の良い微調整(PEFT)のための新しいフレームワークAdaMixを開発しました。AdaMixは、基礎となる適応方法の計算コスト(例:FLOPs、パラメータ)を増加させることなく、ダウンストリームタスクのパフォーマンスを向上させるために適応モジュールの混合を活用します。私たちは、NLUおよびNLGタスク全体でアダプターや低ランク分解などの異なるPEFT手法と連携し、それらを改善するAdaMixを実証しました。

\ PLMパラメータのわずか0.1〜0.2%を調整するだけで、AdaMixはすべてのモデルパラメータを更新する完全なモデル微調整や他の最先端のPEFT手法を上回るパフォーマンスを発揮します。

7 限界

提案されたAdaMix手法は、大規模言語モデルの微調整を含むため、やや計算集約的です。提案されたAdaMixのトレーニングコストは、トレーニング手順にアダプターの複数のコピーが含まれるため、標準のPEFT手法よりも高くなります。経験的な観察に基づくと、AdaMixのトレーニング反復回数は通常、標準PEFT手法のトレーニングの1〜2倍です。これにより、説明されたモデルのトレーニングからのカーボンフットプリントに悪影響が及びます。

\ AdaMixは既存のほとんどのパラメータ効率の良い微調整(PEFT)研究と直交しており、任意のPEFT手法のパフォーマンスを潜在的に向上させることができます。この研究では、アダプターやLoRAなどの代表的な2つのPEFT手法を探索しましたが、プロンプト調整やプレフィックス調整などの他の組み合わせでは実験していません。これらの研究は今後の課題として残しています。

8 謝辞

著者らは、貴重なコメントと有益な提案をいただいた匿名の査読者に感謝し、プロジェクトに対する洞察に満ちたコメントをいただいたGuoqing ZhengとRuya Kangに感謝します。この研究は、米国国立科学財団の助成金NSFIIS 1747614およびNSF-IIS-2141037によって部分的に支援されています。この資料に表現されている意見、発見、結論または推奨事項は著者のものであり、必ずしも国立科学財団の見解を反映するものではありません。

参考文献

Armen Aghajanyan, Sonal Gupta, and Luke Zettlemoyer. 2021. Intrinsic dimensionality explains the effectiveness of language model fine-tuning. In Proceedings of the 59th Annual Meeting of the Association for Computational Linguistics and the 11th International Joint Conference on Natural Language Processing (Volume 1: Long Papers), pages 7319– 7328, Online. Association for Computational Linguistics.

\ Roy Bar Haim, Ido Dagan, Bill Dolan, Lisa Ferro, Danilo Giampiccolo, Bernardo Magnini, and Idan Szpektor. 2006. The second PASCAL recognising textual entailment challenge.

\ Luisa Bentivogli, Peter Clark, Ido Dagan, and Danilo Giampiccolo. 2009. The fifth PASCAL recognizing textual entailment challenge. In TAC.

\ Tom Brown, Benjamin Mann, Nick Ryder, Melanie Subbiah, Jared D Kaplan, Prafulla Dhariwal, Arvind Neelakantan, Pranav Shyam, Girish Sastry, Amanda Askell, Sandhini Agarwal, Ariel HerbertVoss, Gretchen Krueger, Tom Henighan, Rewon Child, Aditya Ramesh, Daniel Ziegler, Jeffrey Wu, Clemens Winter, Chris Hesse, Mark Chen, Eric Sigler, Mateusz Litwin, Scott Gray, Benjamin Chess, Jack Clark, Christopher Berner, Sam McCandlish, Alec Radford, Ilya Sutskever, and Dario Amodei. 2020. Language models are few-shot learners. In Advances in Neural Information Processing Systems, volume 33, pages 1877–1901. Curran Associates, Inc.

\ Ido Dagan, Oren Glickman, and Bernardo Magnini. 2005. The PASCAL recognising textual entailment challenge. In the First International Conference on Machine Learning Challenges: Evaluating Predictive Uncertainty Visual Object Classification, and Recognizing Textual Entailment.

\ Jacob Devlin, Ming-Wei Chang, Kenton Lee, and Kristina Toutanova. 2019. BERT: pre-training of deep bidirectional transformers for language understanding. In Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, NAACL-HLT 2019, Volume 1 (Long and Short Papers), pages 4171–4186.

\ William Fedus, Barret Zoph, and Noam Shazeer. 2021. Switch transformers: Scaling to trillion parameter models with simple and efficient sparsity. arXiv preprint arXiv:2101.03961.

\ Jonathan Frankle, Gintare Karolina Dziugaite, Daniel Roy, and Michael Carbin. 2020. Linear mode connectivity and the lottery ticket hypothesis. In International Conference on Machine Learning, pages 3259–3269. PMLR.

\ Yarin Gal and Zoubin Ghahramani. 2015. Dropout as a bayesian approximation: Representing model uncertainty in deep learning. CoRR, abs/1506.02142.

\ Yarin Gal, Riashat Islam, and Zoubin Ghahramani. 2017. Deep Bayesian active learning with image data. In Proceedings of the 34th International Conference on Machine Learning, volume 70 of Proceedings of Machine Learning Research, pages 1183–1192. PMLR.

\ Tianyu Gao, Adam Fisch, and Danqi Chen. 2021. Making pre-trained language models better few-shot learners. In Association for Computational Linguistics (ACL).

\ Claire Gardent, Anastasia Shimorina, Shashi Narayan, and Laura Perez-Beltrachini. 2017. The webnlg challenge: Generating text from rdf data. In Proceedings of the 10th International Conference on Natural Language Generation, pages 124–133.

\ Danilo Giampiccolo, Bernardo Magnini, Ido Dagan, and Bill Dolan. 2007. The third PASCAL recognizing textual entailment challenge. In the ACLPASCAL Workshop on Textual Entailment and Paraphrasing.

\ Neil Houlsby, Andrei Giurgiu, Stanislaw Jastrzebski, Bruna Morrone, Quentin De Laroussilhe, Andrea Gesmundo, Mona Attariyan, and Sylvain Gelly. 2019. Parameter-efficient transfer learning for nlp. In International Conference on Machine Learning, pages 2790–2799. PMLR.

\ Edward J Hu, Yelong Shen, Phillip Wallis, Zeyuan Allen-Zhu, Yuanzhi Li, Shean Wang, Lu Wang, and Weizhu Chen. 2021. Lora: Low-rank adaptation of large language models. arXiv preprint arXiv:2106.09685.

\ Pavel Izmailov, Dmitrii Podoprikhin, Timur Garipov, Dmitry Vetrov, and Andrew Gordon Wilson. 2018. Averaging weights leads to wider optima and better generalization. arXiv preprint arXiv:1803.05407.

\ Jaejun Lee, Raphael Tang, and Jimmy Lin. 2019. What would elsa do? freezing layers during transformer fine-tuning. arXiv preprint arXiv

関連コンテンツ

チェーンリンク、クジラの動静活発も7か月連続下落

イーサリアム財団が4,000ETH以上を売却、価格反発を妨げるか?